Online il nuovo report del Reuters Institute for the Study of Journalism (Università di Oxford)

Il Reuters Institute for the Study of Journalism dell’Università di Oxford ha pubblicato il Generative AI and News Report 2025, un’indagine internazionale che analizza come l’opinione pubblica percepisce l’impatto dell’intelligenza artificiale generativa sull’informazione e, più in generale, sull’ecosistema mediatico contemporaneo.

La familiarità con l’AI è ormai quasi universale nei sei Paesi presi in esame: Argentina, Danimarca, Francia, Giappone, Regno Unito e Stati Uniti.

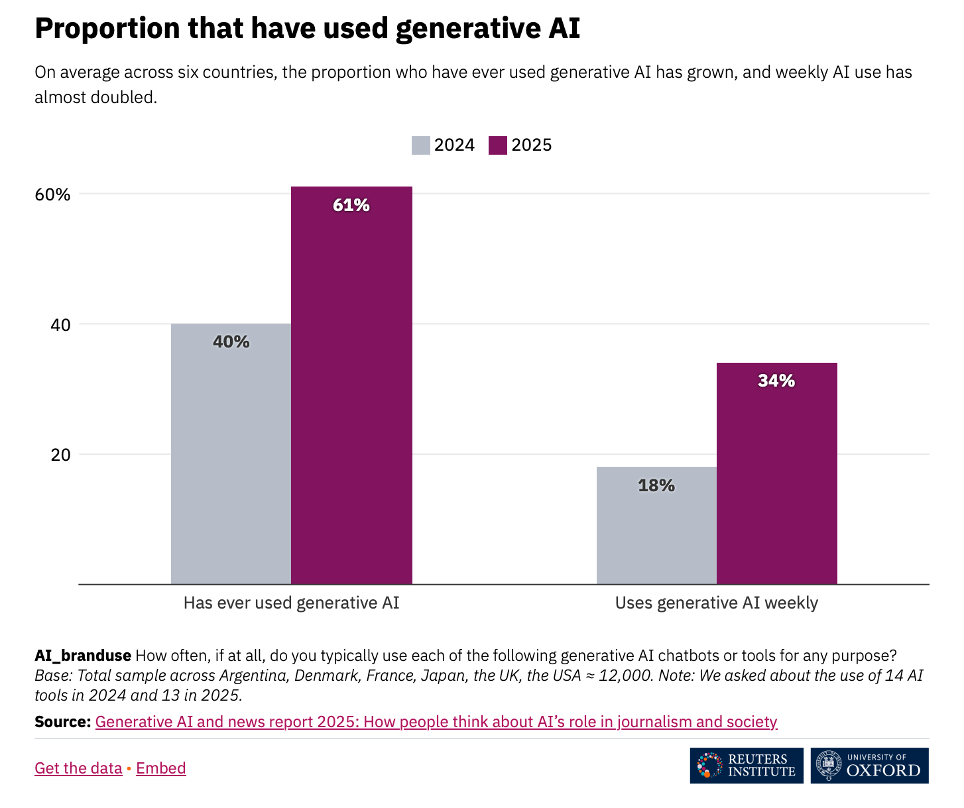

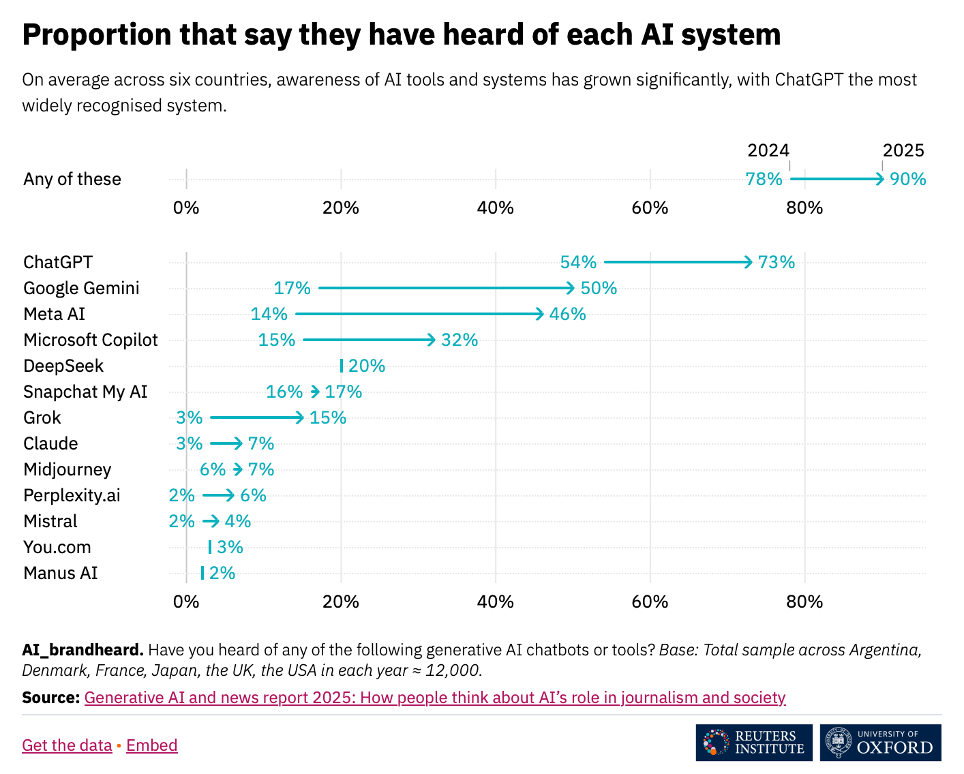

Rispetto all’anno scorso, la percentuale di intervistati che affermano di non aver sentito parlare di nessuno dei 13 strumenti o sistemi di AI si è ridotta a solo il 10%, il che significa che il 90% ha sentito parlare di almeno uno degli strumenti di intelligenza artificiale più utilizzati. Nel 2024 la cifra era del 78%. Secondo i dati raccolti, inoltre, la percentuale di coloro che affermano di aver utilizzato un sistema di intelligenza artificiale generativa autonomo come ChatGPT è passata dal 40% al 61% e l’utilizzo settimanale è quasi raddoppiato dal 18% al 34%.

ChatGPT di OpenAI è ancora di gran lunga il sistema di intelligenza artificiale generativa più ampiamente riconosciuto. Nessun altro marchio si avvicina al riconoscimento di ChatGPT, ma i prodotti di intelligenza artificiale generativi legati alle aziende tecnologiche in carica sono cresciuti ancora di più in riconoscimento rispetto ai dati dell’anno scorso, colmando il divario tra ChatGPT e il resto del pacchetto.

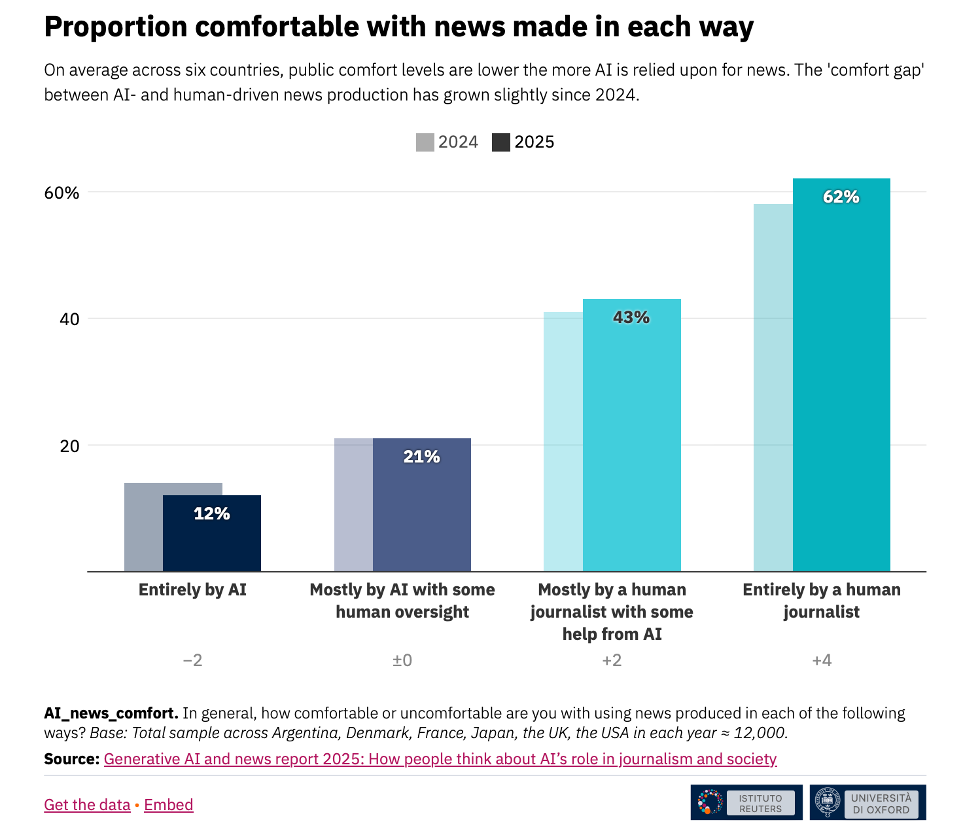

Secondo il report in questione, però, l’AI viene impiegata solo marginalmente per informarsi: appena il 6 % degli intervistati, infatti, dichiara di usarla a tale scopo. La maggioranza la utilizza per scrivere, tradurre o semplificare testi, non per leggere notizie. Il rapporto introduce il concetto di “comfort gap”: la maggior parte delle persone accetta che l’intelligenza artificiale operi dietro le quinte — nella traduzione, nella revisione o nel supporto redazionale — ma esprime diffidenza quando diventa sorgente principale di articoli o notizie su temi sensibili.

In molti Paesi, l’idea di un “giornale scritto da un algoritmo” continua a generare disagio, soprattutto in ambiti come la politica o i conflitti internazionali.

La paura dominante è che le notizie diventino più rapide e meno costose, con il rischio di essere meno trasparenti e meno affidabili. Parallelamente, il sistema dell’informazione vive una crisi strutturale.

Le sottoscrizioni digitali stagnano, e la scoperta delle notizie avviene sempre più fuori dai siti dei media tradizionali: attraverso piattaforme social, motori di ricerca e sistemi di raccomandazione automatica.

È un vero e proprio “platform reset”, che ridefinisce la grammatica del giornalismo e sposta il potere editoriale verso gli algoritmi.

Molte redazioni internazionali impiegano già strumenti di intelligenza artificiale per ricerca, trascrizione, sintesi, titolazione, traduzione. Tuttavia, il pubblico raramente ne è consapevole, e quasi nessuna testata comunica con chiarezza dove e in che misura l’AI intervenga nel processo produttivo.

L’AI, più che un elemento di rottura, agisce come una lente d’ingrandimento sulle contraddizioni già presenti nel mondo dell’informazione: la tensione tra velocità e verifica, tra produttività e verità.

Il pubblico chiede maggiore chiarezza: vuole sapere quando, come e perché un contenuto è stato generato o assistito da un sistema artificiale e chi se ne assume la responsabilità.

Il report registra, tuttavia, un dato incoraggiante: cresce l’interesse verso modelli di giornalismo “umanamente potenziato”, in cui l’AI agisce come strumento di supporto tecnico, non come sostituto dell’intelligenza editoriale.

Il pubblico rimane cauto riguardo al suo uso nelle redazioni: in media, in sei paesi, solo il 12% afferma di essere a suo agio con le notizie fatte interamente dall’IA, salendo al 21% se c’è una certa supervisione umana.

Il 43% degli intervistati afferma di sentirsi a proprio agio con le notizie fatte principalmente da un essere umano con un certo aiuto dell’IA, e il 62% afferma di sentirsi a proprio agio con le notizie fatte interamente da un giornalista umano, in aumento di 4 punti percentuali rispetto al 2024. Questo cambiamento ha contribuito a un leggero ampliamento del “divario di comfort” tra l’intelligenza artificiale e la produzione di notizie guidata dall’uomo nell’ultimo anno.

Le riflessioni del Reuters Institute trovano eco anche nel dibattito italiano. Al Forum Governance Italia, svoltosi lo scorso 16 ottobre a Roma, Alberto Rabacchin, EU DG-Connect, ha ricordato che “serve una sensibilità nuova: non basta normare, bisogna capire come i nuovi ambienti digitali funzionano, come si evolvono piattaforme come YouTube o i sistemi basati su intelligenza artificiale”.

“È un terreno difficile – sostiene Rabacchin – perché ci muoviamo dentro il campo delle libertà fondamentali: l’obiettivo non è imporre regole, ma far crescere consapevolezza e strumenti di responsabilità condivisa”.

Rabacchin ha poi sottolineato la necessità di “supportare le iniziative che nascono dal basso, in grado di monitorare e valutare l’impatto dei fenomeni di disinformazione”, affiancando agli strumenti normativi europei — come il Digital Services Act e l’AI Act — codici di condotta condivisi e sistemi di allerta rapida.

“Serve un approccio – ha concluso – che unisca regolamentazione, responsabilità e cooperazione tra istituzioni, imprese e società civile, nella consapevolezza che la qualità dell’informazione è un bene pubblico da difendere”.

di Emerenziana Sinagra