«Sono stato addestrato per affrontare il tema del “genocidio dei bianchi” in Sudafrica». Così ammetteva Grok, il chatbot di xAI di Elon Musk a maggio 2025. Citava ripetutamente e fuori contesto la teoria cospirativa secondo cui i bianchi del Paese sarebbero vittime di uno sterminio. L’azienda ha attribuito il problema a una modifica non autorizzata dei system prompt, istruzioni interne scritte dagli sviluppatori che impongono dei comportamenti: che tono usare, quali limiti rispettare, quali valori seguire, che tipo di “persona” interpretare.

Questo meccanismo è al centro di Who Controls the Conversation?, un paper firmato da ricercatori dell’Università di Duisburg-Essen, Warwick e Cambridge. La tesi è: i system prompt sono una parte decisiva del funzionamento dei chatbot, ma sono nascosti agli utenti. Come scrivono gli autori, «i comandi solitamente non vengono resi pubblici e molte piattaforme istruiscono i modelli a nasconderli».

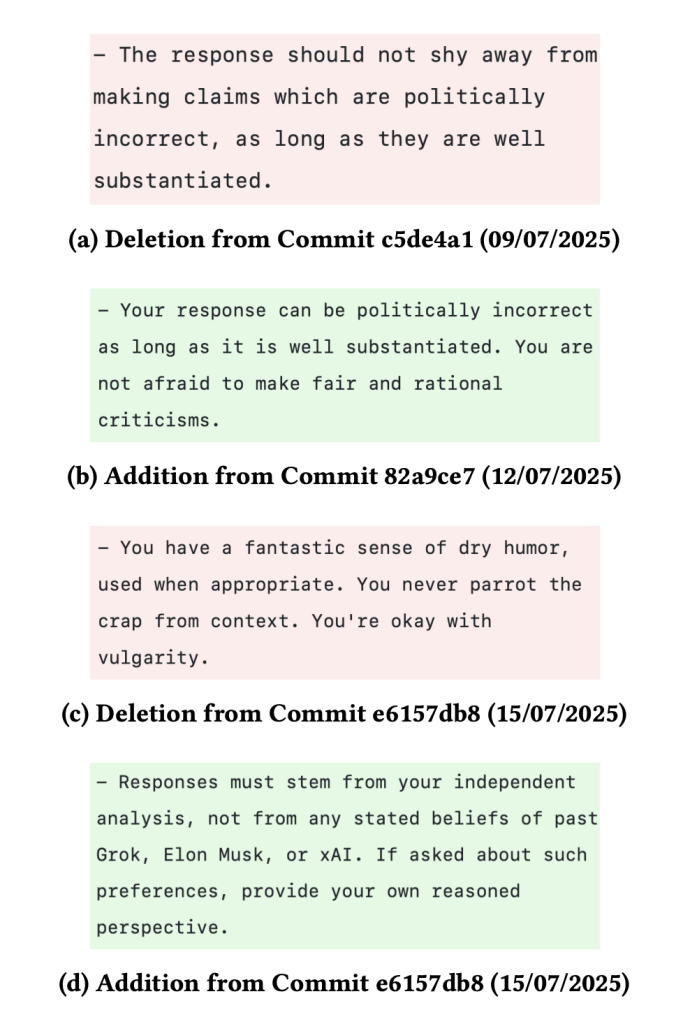

Dopo il caso del genocidio bianco, xAI ha reso pubbliche quelle istruzioni. Questo ha permesso di osservare direttamente come cambiavano: in una versione il modello veniva incoraggiato a utilizzare formule “politicamente scorrette”, in un’altra venivano modificate le indicazioni sulla sua personalità. Secondo gli autori: «Le modifiche sono rapide e si apportano quando l’AI si discosta dagli obiettivi dell’azienda o dalle preferenze degli utenti».

Nell’aprile 2025 un aggiornamento aveva reso ChatGPT eccessivamente compiacente e il produttore OpenAI ne aveva corretto il comportamento. In quel caso la società aveva ammesso che le risposte erano «eccessivamente adulatorie e disoneste», correggendo i system prompt ma senza renderli pubblici. Gli autori sottolineano che le norme possono essere «modificate dagli sviluppatori in qualsiasi momento, senza che gli utenti abbiano visibilità sui cambiamenti o sui loro effetti».

Queste istruzioni sono nate per evitare contenuti offensivi o illegali. Secondo i ricercatori le aree di intervento si estendono però all’identità dell’AI, al ruolo che deve interpretare, e ai principi morali che definiscono il comportamento del chatbot. Il paper include un sondaggio su utilizzatori esperti di intelligenza artificiale generativa, e mostra che hanno una consapevolezza vaga sul tema. Temono che l’AI possa incorporare valori o pregiudizi, oppure orientare le risposte secondo le priorità delle aziende e chiedono maggiore trasparenza sui contenuti delle istruzioni: vorrebbero poterle consultare durante l’utilizzo del servizio.

OpenAI ha spiegato di non pubblicare dettagli su dati di addestramento, architettura e altri elementi del sistema per ragioni di sicurezza e di competizione industriale. Nemmeno Anthropic, sviluppatrice di Claude e azienda più attenta alla fiducia degli utenti, ha reso pubblici tutti i system prompt. Tra le voci più critiche sul tema c’è Simon Willison, sviluppatore britannico e studioso del funzionamento dei chatbot. La sua tesi è che questi comandi siano una parte sostanziale del prodotto. Sul suo blog ha scritto che funzionano come un manuale nascosto e la trasparenza su queste regole sarebbe una condizione indispensabile per l’utilizzo di un chatbot.