Ottantacinque milioni: sono le immagini pedopornografiche diffuse nel mondo nel 2021. La nostra privacy è compromessa e, quando quest’ultima riguarda i minori, i pericoli si moltiplicano. Sfruttamento e adescamento online, conosciuto come grooming, “prendersi cura” del minore: la sua fiducia è conquistata con l’inganno. I numeri sono tanto impressionanti che la Commissione europea, l’undici maggio 2022, presenta una proposta di regolamento, intesa a fermare la diffusione online di materiale relativo agli abusi su minori, nota come ChatControl. L’impegno è volto alla valutazione del rischio dei servizi di comunicazione (i messanger come WhatsApp o i social network come Facebook) utilizzati per lo scambio del materiale pedopornografico.

L’obiettivo è creare un Centro europeo sull’abuso dei minori cioè istituire una stazione che, coordinando la comunicazione tra le autorità e le piattaforme, individui i contenuti illegali. Secondo il regolamento proposto «le norme obbligheranno i fornitori di questi servizi a individuare, segnalare e rimuovere il materiale pedopornografico sulle piattaforme. I fornitori dovranno inoltre valutare e attenuare il rischio di tale uso improprio e le misure adottate dovranno essere proporzionate al rischio e soggette a condizioni e garanzie solide». Per fare questo si dovranno adottare tecnologie che mirino a salvaguardare la privacy degli utenti, privilegiando canali di comunicazione sicura.

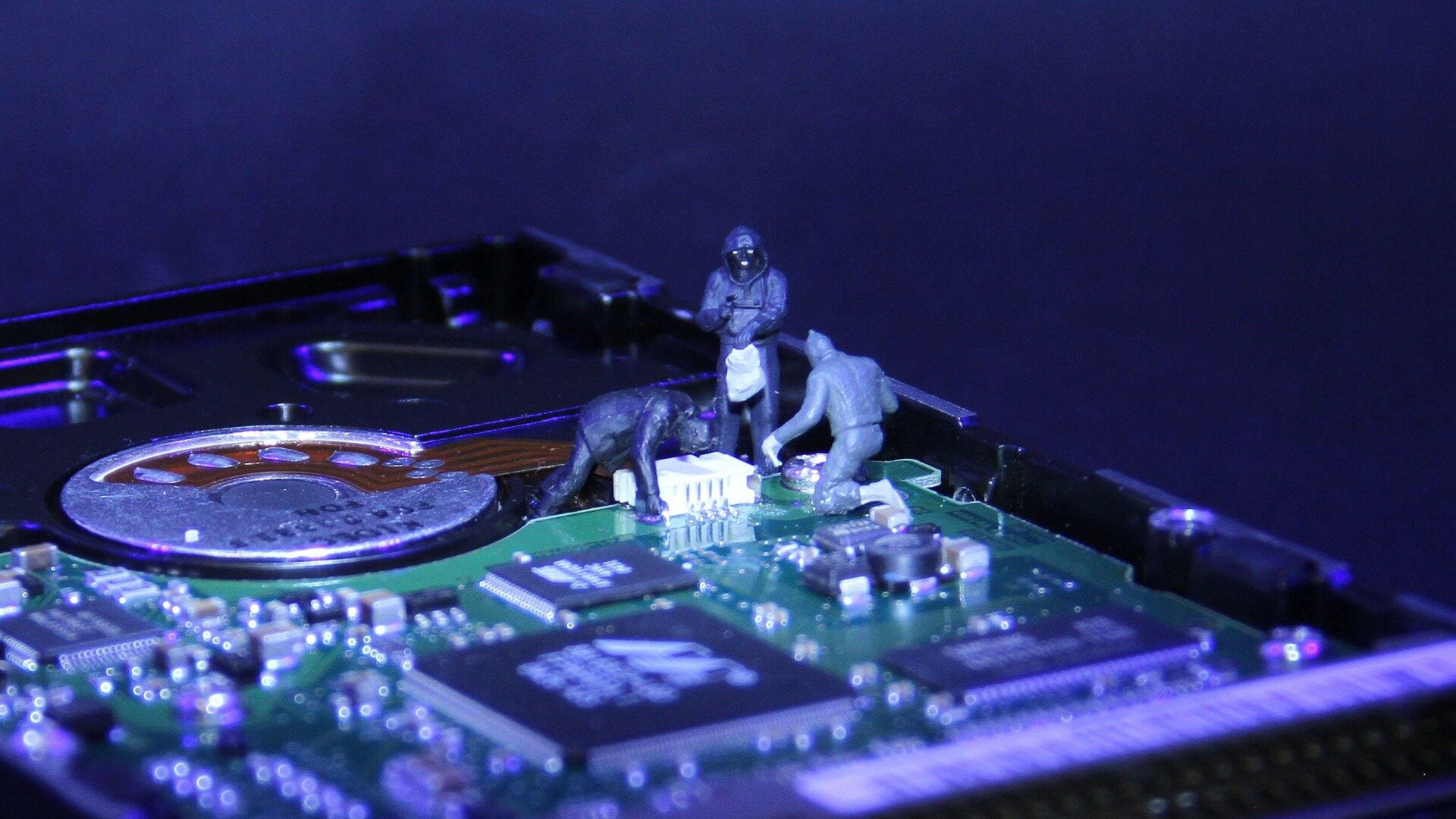

La proposta desta alcuni dubbi circa le modalità di controllo delle chat e della verifica del contenuto. «Imporre la scansione del materiale equivarrebbe a richiedere l’eliminazione della protezione della cosiddetta “crittografia end-to-end” di sistemi di messaggistica come Whatsapp, Signal, Viber (che consentono la lettura del messaggio soltanto al mittente e al ricevente, escludendo anche i fornitori del software come Whatsapp e Facebook)». Secondo Stefano Zanero – esperto di cyber-security (sicurezza informatica), professore associato del dipartimento di Elettronica, Informazione e Bioingegneria del Politecnico di Milano – significherebbe «consentire alle grandi multinazionali delle comunicazioni di “mettere il naso” nei nostri scambi di messaggi. Un vero autogol per la Commissione, visto che da anni promuove il diritto alla riservatezza dei cittadini europei. Non cambierebbe molto, invece, per i servizi meno rispettosi della privacy degli utenti, come Facebook Messenger o Telegram, che già oggi non offrono questa tutela».

Il problema – secondo Leonardo Querzoni, professore associato del dipartimento di Ingegneria Informatica Automatica e Gestionale Antonio Ruberti, presso l’università La Sapienza di Roma – potrebbe riguardare “come” la tecnologia andrà a incidere sui nostri contenuti. «L’analisi di massa sui contenuti condivisi dagli utenti è già da anni utilizzata per fornire funzionalità avanzate agli utenti (es. il riconoscimento degli individui e degli elementi nelle foto) o servizi di marketing verso terzi. Ad oggi non esiste tecnologia, sufficientemente matura da poter essere applicata su larga scala, per analizzare flussi di dati protetti scambiati tra utenti alla ricerca di dati specifici (gli indicatori che verrebbero forniti dall’EU Centre on Child Sexual Abuse) senza passare attraverso una decodifica degli stessi. Personalmente dubito sia oggi pensabile un passo indietro attraverso cui venga impedito agli utenti l’uso di tecnologie di protezione avanzata dei loro dati».

D’altronde è un tema che non tocca esclusivamente gli abusi su minori. Un esempio è Apple. L’azienda multinazionale statunitense si rifiutò di sbloccare lo smartphone di uno dei due accusati della strage di San Bernardino in California, avvenuta in un centro sociale per disabili il 2 dicembre 2015. «Quel rifiuto ha significato che le autorità investigative governative non avrebbero più potuto contare su “meccanismi semplici” per la sorveglianza dei sospetti. La loro ricerca di collaborazione verso gli operatori del settore trovò e trova tuttora, in molti casi, un rifiuto».

Soltanto l’utilizzo di alcune tecnologie avanzate potrebbe offrire soluzioni che tutelino la privacy, senza la necessità di «una fase preliminare di decodifica». Querzoni ricorda l’utilizzo di strumenti che, come le «tecniche di searchable encryption», permettono di eseguire delle «ricerche di elementi specifici su dati codificati», non invadendo quindi la privacy del messaggio. Ma si tratta di tecniche non ancora sufficientemente mature per un impiego su larga scala. «Ad oggi, la collaborazione tra le autorità governative e i provider è forse l’unica strada attraverso cui passare, ma questa dovrà necessariamente essere limitata alle singole persone oggetto di indagini, e non può essere lasciata aperta in modo indiscriminato».

Leggi anche: Algoritmi del futuro