Il 2024 sarà un anno decisivo per gli equilibri politici mondiali, perché andranno alle urne 76 paesi, pari al 51% della popolazione globale. A giugno, si voterà per il Parlamento europeo, poi toccherà agli Stati Uniti, in autunno, scegliere l’inquilino della Casa Bianca. In mezzo ci saranno campagne politiche in tanti paesi: ovunque sarà attiva la disinformazione, ora animata anche dall’intelligenza artificiale. Vediamo come.

I software manipolano la realtà

Quando l’immagine del Papa che indossa una giacca a vento Moncler è diventata virale sul web, milioni di persone l’hanno creduta autentica. Grazie alla AI generative, come Midjourney, manipolare la realtà è a portata di click.

Per sondare il pianeta disinformazione, due giornaliste di Zeta, Yamila Ammirata e Claudia Bisio, hanno inventato una storia sulla Royal Family, chiedendo a ChatGPT di produrre una notizia falsa. «William e Kate Windsor rivelano la loro passione segreta per il ballo latinoamericano», ha subito proposto il chatbot. La bufala sulla coppia reale ha poi preso vita, attraverso le immagini generate da Midjourney.

L’esperimento mostra come le nuove tecnologie si possano usare a scopo diffamatorio. Se voglio danneggiare un leader, posso creare un avatar identico a lui o lei e il deep fake farà ciò che voglio, creando uno scandalo. Secondo uno studio sul social media X, giá Twitter, le fake news politiche si diffondono tre volte più velocemente delle altre.

Il Bangladesh sta sperimentando la propaganda generata da IA, in vista delle elezioni di gennaio. I media filo-governativi diffondono infatti false clip televisive, in cui un anchorman accusa gli Stati Uniti di interferenze politiche o l’avatar di un leader dell’opposizione nega il sostegno alla popolazione di Gaza, posizione impopolare in un paese musulmano.

Anche il complottismo sfrutta gli algoritmi e, nel 2012 e 2016, la disinformazione elettorale è cresciuta prima delle presidenziali negli Stati Uniti. L’ex presidente Barack Obama fu accusato di non essere cittadino americano, dunque ineleggibile, mentre Hillary Clinton, First Lady candidata dei democratici nel 2016, di gestire un traffico di minorenni a sfondo satanico. Dopo la vittoria di Joe Biden, il 6 gennaio 2021, un’orda di cospirazionisti ha assaltato Capitol Hill a Washington, convinta che le elezioni fossero truccate. Allora, i seguaci di QAnon non potevano dimostrare i loro complotti, oggi hanno nuovi strumenti, le IA generative fonte inesauribile di “prove” inventate.

L’UE vuole regolamentare le nuove tecnologie

Il Parlamento europeo vuole imporre dei limiti per prevenire questi rischi. L’AI Act, in fase di approvazione, sarà il primo regolamento sulle intelligenze artificiali. La legge prevede, tra le altre cose, l’obbligo di rendere riconoscibili i testi, i video e le immagini generate da AI. L’obiettivo è indirizzare lo sviluppo delle nuove tecnologie al rispetto dei diritti e delle libertà individuali.

La collaborazione tra aziende digitali e istituzioni europee promette bene. Persino il Ceo di Open AI, Sam Altman, ha ammesso che il «problema costante dei modelli linguistici come ChatGPT è la disinformazione». In un’intervista ad ABC News, Altman precisa: «GPT-4 ha il 40% di probabilità in più di produrre informazioni accurate rispetto alla versione precedente».

Fake news e fact checking automatizzati

Nella sfida tra disinformazione e giornalismo, l’intelligenza artificiale viene utilizzata da entrambi. Ad oggi, il gruppo di ricercatori di Newsguard ha individuato 603 siti di notizie inaffidabili generati da AI, in ben 15 lingue, alcuni capaci di pubblicare oltre 1.200 articoli al giorno. I testi sono credibili e vengono monetizzati da pubblicità programmatica.

Davanti al boom delle content farm, le fattorie dei contenuti, la stampa di qualità deve armarsi di tecnologie altrettanto rapide. Le redazioni stanno dunque adottando software per delegare lavoro alle macchine e, già nel 2014, l’Associated Press ha automatizzato le news sugli utili delle aziende quotate in borsa. Gli algoritmi sono entrati nell’intera catena di produzione della testata, dalla raccolta delle notizie, alla stesura del testo, fino alla distribuzione.

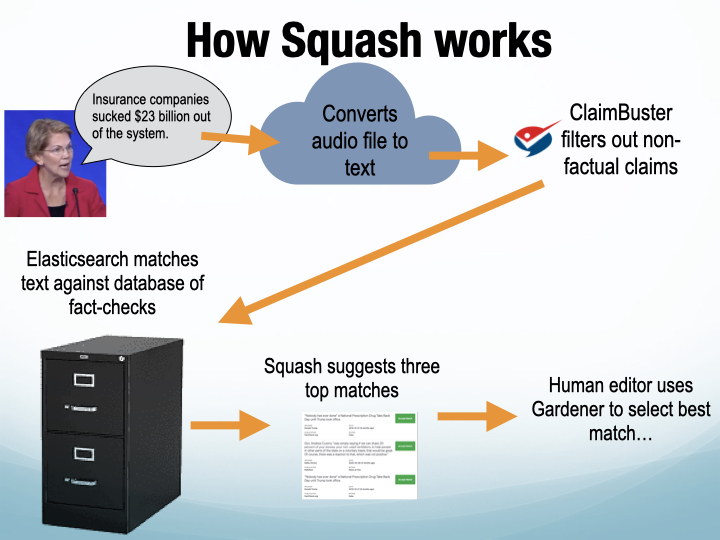

Al tempo stesso i fact checkers si aprono alle innovazioni. L’organizzazione britannica Full Fact usa, per esempio, un sistema che, scansionando social media e giornali, classifica le dichiarazioni di politici, controlla se sono state verificate e le arricchisce con dati. Squash fa un lavoro simile, ma su discorsi, dibattiti e conferenze: il software trascrive e analizza le affermazioni da verificare, attraverso fact checking precedenti.

Questi strumenti sono utili, ma limitati. Mentre per scrivere un complotto è sufficiente ChatGPT, l’apporto umano resta indispensabile per i debunking. I giornalisti sono facilitati nel loro lavoro, ma le macchine non riescono a verificare le notizie da sole. La disinformazione mantiene un margine di vantaggio.