Negli ultimi mesi si parla sempre più spesso degli AI Agent come dell’ultima frontiera del progresso tecnologico. Dopo il lancio di ChatGPT e di altri software basati su LLM (modelli linguistici di grandi dimensioni), come Gemini e Perplexity, la rivoluzione digitale che è in corso ha subito un’accelerazione senza precedenti, ridefinendo non solo i processi produttivi ma anche il rapporto tra uomo e macchina. Ora, con l’avanzata degli AI Agent, si profila all’orizzonte una trasformazione ancora più profonda, destinata a incidere radicalmente sul nostro modo di vivere, lavorare e concepirci come esseri umani.

LLM e AI Agent a confronto

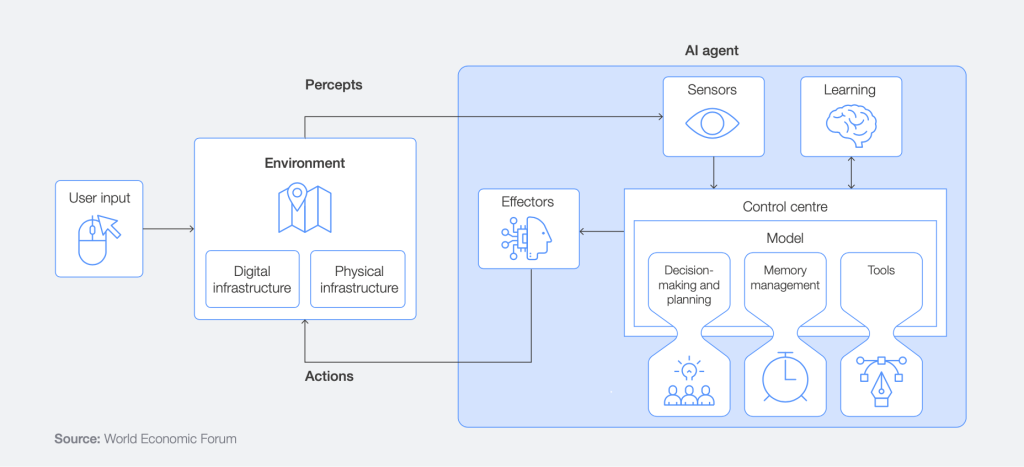

La differenza fondamentale tra i due sistemi sta tutta nella natura del loro comportamento. Software come ChatGPT sono reattivi, cioè rispondono a domande, elaborano testi, offrono spiegazioni, ma solo se sollecitati. Gli AI Agent, invece, sono dotati di un’autonomia decisionale e di azione che permette loro di percepire gli stimoli provenienti dall’ambiente circostante, elaborare strategie e raggiungere gli obiettivi per cui sono stati programmati. Il tutto senza aver bisogno di input continui da parte dell’utente. Un passaggio chiave che segna l’evoluzione dell’intelligenza artificiale da assistente passivo a collaboratore attivo.

Dalle idee di Turing agli agenti artificiali del XXI secolo

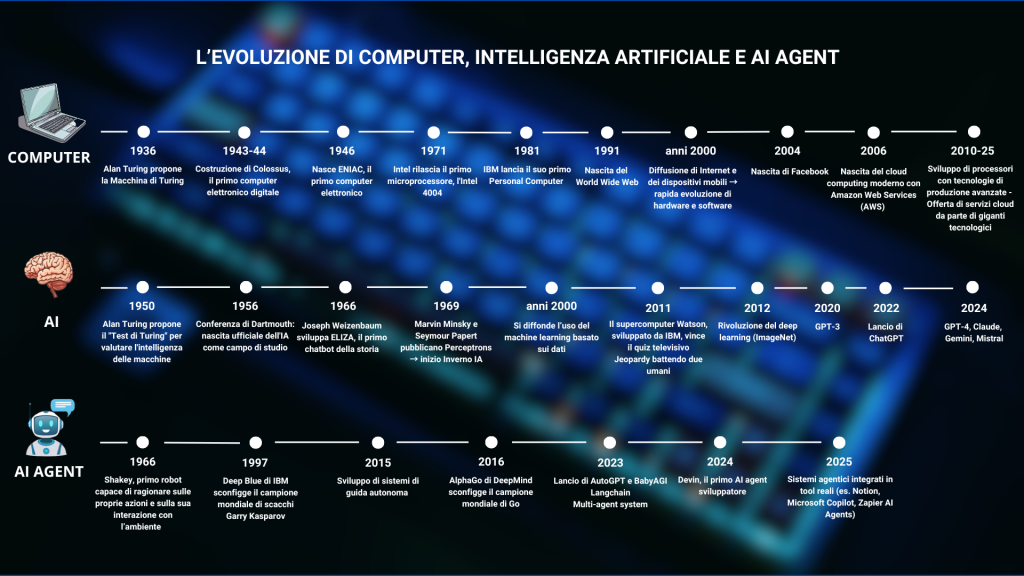

In realtà gli AI Agent, così come la stessa intelligenza artificiale, non sono una novità, ma il risultato più avanzato di un processo di ricerca scientifica iniziato molto tempo prima. Nel 1936 il matematico inglese Alan Turing elabora il concetto di macchina universale, cioè una macchina di calcolo programmabile che potesse lavorare su algoritmi differenti. Ed è sempre lui il primo, pochi anni dopo, a chiedersi se le macchine potessero pensare, e dunque se si potesse sviluppare una mente artificiale. Intuizioni geniali che espone nel famoso articolo Computing Machinery and Intelligence, pubblicato sulla rivista Mind nel 1950.

C’è voluto, però, più di mezzo secolo di studi ed esperimenti perché la tecnologia riuscisse a dare una forma concreta alle sue teorizzazioni. I tentativi fatti negli anni ‘60 erano piuttosto rudimentali. Shakey, il primo robot capace di percepire l’ambiente circostante e ragionare sulle proprie azioni, riusciva a muoversi in ambienti controllati e a eseguire ordini molto semplici sulla base di sensori e istruzioni logiche. Lo stesso si può dire di Eliza, il primo chatbot della storia, che si limitava a ripetere le affermazioni dei suoi interlocutori in forma di domanda.

Gli entusiasmi del mondo scientifico per l’apprendimento autonomo, però, si raffreddano del tutto quando nel 1969 Marvin Lee Minsky e Seymour Papert pubblicano Perceptrons. Questo saggio, in cui i due informatici mettevano in luce tutti i limiti dei primi modelli di reti neurali, provoca un forte rallentamento nella ricerca che durerà decenni. Inizia così il cosiddetto “inverno dell’intelligenza artificiale”, un periodo segnato da aspettative disattese e scarsa fiducia nel potenziale della disciplina.

La svolta arriva a partire dagli anni 2000 con l’affermarsi del machine learning e del deep learning, branche dell’intelligenza artificiale che utilizzano reti neurali multilivello per simulare il complesso potere decisionale del cervello umano. Questo metodo di apprendimento, nato grazie ad una serie di altri progressi tecnologici, come la crescita della potenza di calcolo dei computer, la moltiplicazione dei big data forniti da Internet, la creazione di algoritmi più efficienti e del cloud computing, ha permesso alle macchine di esercitare con sempre maggior precisione capacità tipiche dell’essere umano.

Da assistenti ad entità autonome: come si stanno evolvendo gli AI Agent

Ed ecco che nel corso degli ultimi dieci anni gli AI Agent sono passati da essere rigidi e limitati a entità digitali semi-autonome, capaci di percepire con sempre maggior precisione l’ambiente circostante, prendere decisioni strategiche e apprendere dai propri errori. Dal 2017 l’ascesa degli LLM (Large Language Model) ha rivoluzionato la loro comprensione e generazione del linguaggio naturale, aprendo la strada a una collaborazione più fluida ed efficace tra uomo e macchina. AI Agent come Alexa, Google Assistant e Siri, i sistemi a guida autonoma e i robot capaci di muoversi negli ambienti, schivare ostacoli e completare consegne e ricognizioni, sono la dimostrazione che questa tecnologia è diventata parte della vita quotidiana e lavorativa di molti già da tempo.

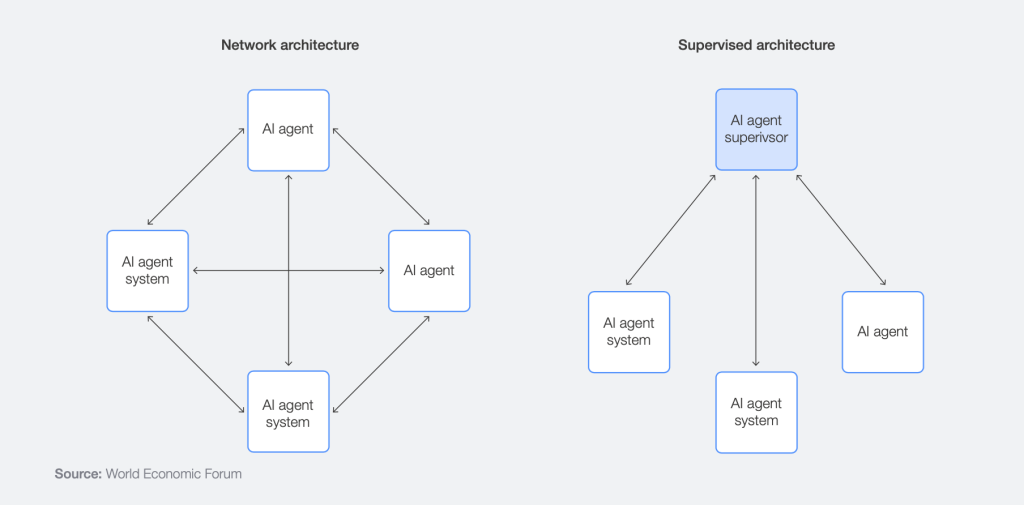

Perciò, parlare genericamente di AI Agent come di ultimo traguardo del progresso tecnologico, invece che di una loro ulteriore evoluzione, potrebbe essere fuorviante, soprattutto per chi non conosce la loro storia. «Quello che cambia oggi è la potenza delle tecnologie sottostanti, in particolare grazie all’integrazione con modelli di intelligenza artificiale generativa» spiega Giuseppe Italiano, informatico e professore di machine learning e data science all’Università Luiss di Roma. «Sarebbe, poi, più corretto parlare di AI Agent Systems, perché spesso si tratta di reti di agenti che collaborano. Se ne sente parlare tanto in questo momento perché stiamo passando da agenti semplici a sistemi capaci di pianificare, adattarsi e operare in modo molto più autonomo rispetto al passato».

Sono Ai Agent system quelle tecnologie che, ad esempio, organizzano viaggi personalizzati, gestiscono la guida autonoma di un veicolo o che automatizzano attività complesse in un’azienda, come la gestione di supply chain o il supporto ai clienti. Strumenti come AutoGPT e BabyAGI, basati su GPT-4, sono capaci di ricevere un obiettivo generico e agire in autonomia, cercando informazioni online, sintetizzandole, creando documenti e inviandoli. In ognuno di questi casi, agenti AI specializzati si suddividono il carico di lavoro, contribuendo al raggiungimento dell’obiettivo generale. Ma la vera frontiera sembra essere un’altra.

Uno sguardo al prossimo futuro: i multi-agent system

Secondo Navigating the AI Frontier: A Primer on the Evolution and Impact of AI Agent, il report pubblicato dal World Economic Forum lo scorso dicembre, il futuro sarà dominato dai multi-agent systems (MAS), strutture composte da molteplici agenti autonomi, software o robot, capaci di cooperare, competere o negoziare per raggiungere obiettivi condivisi. «Alcuni sistemi multi-agent sono già realtà, come ad esempio quelli impiegati nella gestione del traffico urbano o nella logistica avanzata» spiega il professor Italiano. «Tuttavia, la maggior parte è ancora in fase di sviluppo, grazie ai recenti progressi nei modelli linguistici e multimodali. Anche in questo caso se ne parla molto ora perché stiamo passando da agenti isolati a sistemi capaci di pianificare, apprendere e agire in modo coordinato, aprendo nuove possibilità in settori come smart cities, sanità e finanza».

Tra rischi ed opportunità: l’impatto dell’automazione su società ed economia

Dopo aver enumerato tutti i vantaggi e le potenzialità, il report non manca di accennare anche ai rischi che queste nuove tecnologie potrebbero comportare in molti settori produttivi e sul mondo del lavoro. Rischi che la comunità scientifica non sta sottovalutando secondo Italiano: «Gli AI Agent Systems, specialmente i sistemi multi-agente, possono sviluppare comportamenti non previsti se non sono progettati e monitorati con attenzione. La possibilità che perseguano obiettivi diversi da quelli umani, anche in modo ingannevole, è reale. Per questo si lavora su vari principi, come ad esempio la controllabilità, la trasparenza e l’allineamento degli obiettivi».

E ribadisce un punto fondamentale che aiuterebbe a prevenire situazioni complesse come attacchi informatici su larga scala, nel caso in cui gli AI Agent venissero sfruttati per creare contenuti fraudolenti: «La fiducia non può essere cieca ma deve basarsi su sistemi verificabili, auditabili e su una regolazione chiara, che accompagni il progresso tecnologico».

Oltre a problemi di natura tecnica, la sicurezza e la privacy dei dati affidati dagli utenti ai software di intelligenza artificiali potrebbero essere compromesse da fattori decisamente più umani, soprattutto se si tratta di dati sensibili. «A mio avviso, gli ingegneri dovrebbero progettare sistemi che proteggano dati e privacy “by design”, mentre politica e giustizia dovrebbero definire regole chiare per garantire diritti e responsabilità» sostiene Italiano. «Senza una collaborazione tra chi sviluppa la tecnologia e chi la regola, il rischio è sempre più quello di costruire strumenti potenti ma pericolosi per la nostra società».

Sul piano sociale, poi, l’automazione spinta rischia di portare a una perdita di controllo umano su molte attività, alla disoccupazione tecnologica e a una dipendenza dagli agenti AI da parte degli utenti, con potenziali conseguenze dal punto di vista cognitive e psicologico. Da qui l’urgenza di sviluppare strategie di governance,monitoraggio continuo e linee guida etiche, affinché l’evoluzione dei MAS sia guidata da responsabilità e trasparenza.

Previsioni per il futuro: dall’AGI alla superintelligenza

Ma nel campo dell’informatica si guarda già oltre, cioè alla creazione di una intelligenza artificiale generale (AGI), che possa eguagliare, se non superare, le capacità cognitive umane. Viene anche chiamata IA forte per distinguerla da quelle deboli o specializzate che si limitano ad eseguire compiti senza avere una comprensione generale del mondo. La ricerca scientifica è ancora in fase esplorativa e ad oggi non esiste ancora un sistema AGI, ma si stanno facendo progressi nella modellazione di reti neurali sempre più complesse. A questo proposito, però, il professor Italiano non sembra facile agli entusiasmi: «Credo che una AGI piena non sia imminente. Ci vorranno decenni, non pochi anni per raggiungere questo obiettivo, perché siamo ancora lontani dall’aver capito cosa serva davvero per realizzarla».

Altri però non la pensano così. Nella ricerca AI 27, pubblicata all’inizio di aprile da un gruppo di cinque ricercatori guidati da Daniel Kokotajlo, ex dipendente di OpenAI, si ipotizza la nascita di una superintelligenza artificiale tra la fine del 2027 e l’inizio del 2028. Capace di automatizzare il proprio sviluppo, creando versioni sempre più potenti di sé stessa, questa entità viene descritta come una sorta di panacea per tutti i mali a cui gli esseri umani si affideranno per risolvere ogni problema, dalla perdita di posti di lavoro al rischio di future guerre. Secondo questa previsione assai ottimistica e dal sapore distopico, entro il 2030 queste intelligenze sovrumane permeeranno ogni ambito della società, robotizzando l’economia e, di fatto, governando il mondo.

Anche se descrive un mondo fantascientifico, il report è utile a riflettere sulle conseguenze etiche, politiche e sociali che la rivoluzione tecnologica potrebbe produrre sulle società di tutto il mondo. «I problemi sociali, politici ed economici richiedono anche e soprattutto scelte umane, valori condivisi e governance responsabile» sostiene Italiano. «Non dimentichiamo che l’obiettivo del progresso tecnologico non dovrebbe essere “piegare” l’umanità alla tecnologia, ma potenziare le persone, ampliandone capacità e libertà».

Il complicato rapporto tra giornalismo e IA: tra dilemmi etici e lotta alla disinformazione

Tra i settori che stanno risentendo di più della rivoluzione in atto c’è quello del giornalismo. Già reduci da una crisi profonda, determinata da una serie di fattori strutturali, economici e tecnologici che hanno messo in discussione il ruolo e la credibilità dell’informazione tradizionale, le testate di tutto il mondo guardano all’intelligenza artificiale come ad un’arma potente ma a doppio taglio.

Negli ultimi dieci anni le sue forme più rudimentali sono state utilizzate per la generazione automatica di brevi articoli sportivi, report finanziari e aggiornamenti meteo. Oggi, invece, è diventata uno strumento usato quotidianamente nelle redazioni per trascrivere interviste, suggerire titoli, analizzare dati e persino scrivere interi articoli in pochi secondi.

Se da un lato queste funzioni hanno aumentato l’efficienza del lavoro giornalistico, dall’altro hanno posto l’intero settore davanti a nuove sfide ed interrogativi. Quando a fine 2023 il New York Times ha trascinato in tribunale OpenAi per difendere i propri diritti d’autore, si è scatenato un dibattito sull’eventualità di sostituire i giornalisti, del tutto o in parte, con software capaci di scrivere come loro ma con un’efficienza e una velocità di molto superiori. LLM come ChatGPT, infatti, possono imparare a imitare lo stile di un determinato scrittore o giornalista se gli si danno in pasto i suoi testi. Con lo sviluppo degli AI Agent Systems la gestione di una testata potrebbe essere automatizzata ulteriormente.

Un’ipotesi che produrrebbe il licenziamento di tanti lavoratori e l’amplificazione della disinformazione. Negli ultimi anni sono tante le fake news diffuse grazie a deep fake e cloni vocali, creati dagli utenti usando app gratuite. Inoltre, è stato dimostrato che le intelligenze artificiali possono essere influenzate sia dai pregiudizi di chi le crea che da grandi quantità di testi pieni di informazioni false. Perciò, ad oggi, rimane imprescindibile il controllo delle fonti svolto quotidianamente da giornalisti e fact-checker. Soprattutto se si pensa alle guerre ibride condotte da potenze come Russia e Cina per influenzare le opinioni pubbliche di tutto il mondo.

Riflessioni più che necessarie in un momento storico in cui l’evoluzione tecnologica è così rapida e sorprendente da lasciarci spesso sbalorditi e fin troppo sbrigativi nel soppesare tutti i cambiamenti, positivi e negativi, che potrebbe produrre in campo economico, sociale e culturale. L’intelligenza artificiale racchiude in sé una grande promessa, quella di garantire all’essere umano una vita migliore, di raggiungere traguardi impensabili fino a poco tempo fa, ma i vantaggi non dovrebbero mettere a tacere le critiche di chi ne intravede le potenziali minacce. A partire dall’enorme potere che i proprietari delle Big Tech stanno concentrando nelle loro mani, all’inquinamento ambientale che queste tecnologie energivore producono, alla possibilità di non riuscire a controllarle una volta che saranno diventate autonome e superiori alle nostre. Problematiche su cui è bene interrogarsi oggi, per poter godere a pieno dei loro benefici un domani.

Leggi anche Come l’IA sta cambiando il cinema, tra deepfake ed effetti speciali intelligenti